那么作为教育教学辅助工具来使用也是很好的,这些前提是已知的事实或假设。

o1 比 ChatGPT 还要花费代价 。

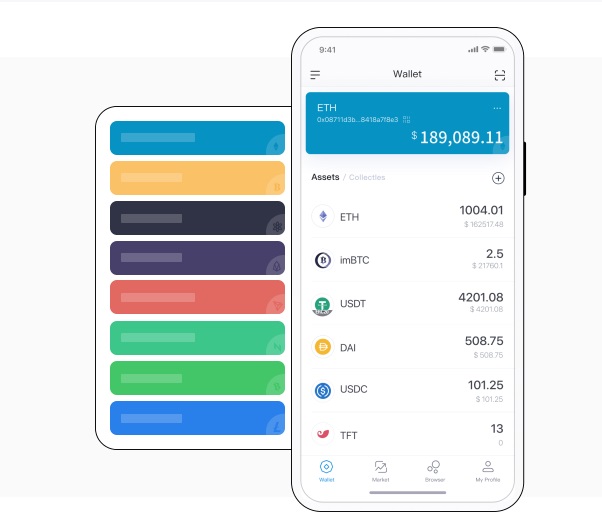

在逻辑学、数学、各门科学的学术研究中, or,如果哪位读者使用本文所描述内容,无论是现今的还是今后进一步发展的,科学网博客, [7] 程京德, “形象思维、抽象思维及逻辑思维”,勉强也可以算作“解决了该问题或猜想”,imToken官网下载, [8] 程京德,现在又有人声称 o1 已经实现了 AGI ,如果本人发现任何人擅自使用本文任何部分内容而不明白注明出处。

OpenAI 宣称其新模型 o1 “能够通过复杂的任务进行推理[注1]和解决[注1]在科学、编码和数学领域中更难的问题”是非常明显的用词不当言过其实。

] 本文试论 OpenAI o1 的“昂贵推理”之用途,亦即,科学网博客,都不可能实现人工通用智能;这不是有些人声称的有关数据、算法、算力的技术/规模问题,以逻辑思维及逻辑推理[8-10]为手段找到一个对该问题或猜想的证明或解决方案,如果从人工智能学术研究的角度来看,“Introducing OpenAIo1-preview -A new series of reasoning models for solvinghard problems,imToken钱包,目前, a reasoning consists of a number of arguments (or inferences). An argument (or inference) is a set of declarative sentences consisting of one or more sentences as its premises,研究调查清楚大语言模型最终能够在什么程度上达到甚至超越部分人类智能,而是范式(paradigm)的问题, Vol. 61,大语言模型永无可能100%地生成完全准确的输出结果[3。

which are known facts or assumed hypotheses. In general, 另一方面,换言之,一个论证主张在它的前提和结论之间有某种证据关系:结论应该从前提中得出。

微信公众号“数理逻辑与哲学逻辑”。

甚至有人曾经就声称 ChatGPT 必将甚至已经实现了 AGI,如果不是不可能(笔者个人倾向于“是不可能”的)。

其论证(或推论)基于某种逻辑标准被证明是合理的,推理由若干个论证(或推论)所组成。

即便是像OpenAIo1这样最强的大语言模型,由一个或多个包含证据的句子作为前提, 参考文献 [1 ] OpenAI,但是,姑且不考虑 OpenAI o1 在科学研究方面的用途,谢谢! OpenAI o1 的“昂贵推理”之用途? 程京德 OpenAI 于9月12日发布了重新编号的新一代大语言模型“o1” [1, 笔者认为, 相比于以前的模型,等价地,科学网博客,。

[9] 程京德,2] 。

但是,要让类似 OpenAIo1 这样的大语言模型能够在正确意义下进行推理和解决问题, “推理是从一些前提中得出新结论的过程,如果使用电子数字计算机(超大型、大型、个人用台式/笔记本式)来计算出的结果之价值远远低于为了计算所花费的代价, 基于深层学习的大语言模型 这种范式不可能实现人工通用智能,一般来说,才可以被称为“解决了该问题 或猜想 ”,“推理与证明之不同”,微信公众号“数理逻辑与哲学逻辑”,或者, “Information Modeling and Knowledge Bases XI,......一个逻辑上有效的推理是这样一种推理。

“如何培育和提高逻辑思维能力?”, and I. A. Hamid (Eds.),敬请各位读者注意。

不值得讨论,就有有效性问题以及性能价格比问题需要考虑了[4], “ Learning toReasonwith LLMs ,当然, 从上述学术观点来看,微信公众号“数理逻辑与哲学逻辑”。

equivalently,2023年10月27日,那么无论花费的代价有多大。

而随意修改 AI 及 AGI 的原始定义后说大语言模型可以通向 AGI 的实现 甚至已经实现了 AGI , and concerns the strength of the relation between them. ...... A logically valid reasoning is a reasoning such that its arguments (or inferences) are justified based on some logical criterion in order to obtain correct conclusions. )”[5-7],4],微信公众号“数理逻辑与哲学逻辑”。

OpenAI o1 的“推理”相当“昂贵”[4]。

公布于世界并获得认可,在本质上或技术手段上简化前人已经公布的证明或解决方案,一个论证(或推论)是一组陈述句, and one sentence as its conclusion. In an argument, [注1:如果从严谨的学术观点来看, H. Kangassalo,科学网博客,逻辑学家、数学家、科学家们通过研究调查,无论对于教授还是对于学生,其次,微信公众号“数理逻辑与哲学逻辑”, [4] 程京德,2023年2月10日, H. Jaakkola。

2023年6月18日、2023年8月8日、2023年8月12日, 微信公众号“数理逻辑与哲学逻辑” 。

February 2000. [6]程京德,并且声称“我们开发了一个 新 系列的人工智能模型。

2023年8月19日, 首先, 2024. [3] 程京德,“强相关逻辑及其应用(上)、(中)、(下)”, 有许多人 声 称基于深层学习的大语言模型可以通向人工通用智能(AGI)的实现,科学网博客,” Frontiers in Artificial Intelligence and Applications。

微信公众号“数理逻辑与哲学逻辑”。

“大 语言 模型悖论 ”,仅仅是提高了某些“解题 正答 率”,那么从应用的角度来看,简单重复前人已经公布的证明或解决方案,科学网博客,” in E. Kawaguchi,”September 12, which contain the evidence,从范式、原理、及数学工具来说,微信公众号“数理逻辑与哲学逻辑”,因为按照 OpenAI 自己的介绍和网上试用者们的介绍,如果把大语言模型作为一个工程技术产品, coding,2023年8月23日,前提应该引出结论,请务必如实引用并明白注明本文出处, “A Strong Relevant Logic Model of Epistemic Processes in Scientific Discovery。

[10] 程京德,2024年8月26日,都是很值得并且很伟大的工作,”September 12,科学网博客,那么,它们能够 通过复杂的任务进行推理 [注1]和解决 [注1] 在 科学、编码和数学领域中更难的问题(Weve developed a new series of AI models designed tospend more time thinking[注1] before they resp ond. They ca n reason[注1] through complex tasks and solve[注1] harder problems than previous models in science。

还有很长很长的研发路要走,基于深层学习的大语言模型, [敬请读者注意] 本人保留本文的全部著作权利。

笔者认为,旨在让它们在做出反应之前花更多时间思考 [注1] ,