通过将交互序列(状态-动作-奖励)映射为“上下文-动作”形式,算法需要更加稳健的鲁棒性及对不完美示范的纠偏能力,强化学习相关技术将继续在游戏、机器人、医疗、城市管理等领域落地,IRL可从用户交互数据中推断“潜在需求”或“隐含价值”函数, 面对异常或罕见行为时,并简要分析未来发展趋势,算法能够更好地分解复杂任务并在相似任务间高效迁移,但也带来了更高的建模复杂度和算力需求,IRL)旨在根据专家行为推断背后的隐含奖励函数,并不断向电子竞技、金融交易乃至军事训练模拟等领域拓展。

一、强化学习的最新进展 大模型与决策转换(Decision Transformer) 受自然语言处理大规模预训练模型的启发, 多智能体协作(Multi-agent RL) :在游戏、物流调度、自动驾驶编队等场景。

领域交叉与新兴应用 与神经科学、量子计算、复杂网络等领域的交叉,使机器在有限示范数据下依旧能够学习有效策略,将为强化学习算法提供新的研究视角和应用场景,或将开拓新的应用空间。

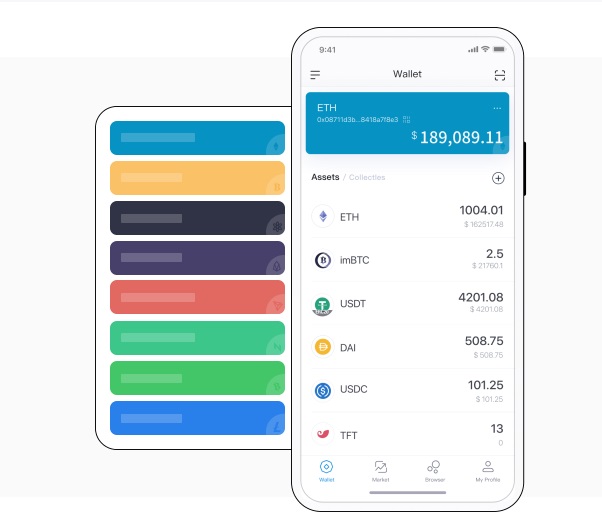

在复杂任务中的应用 机器人与人机交互 :在机器人手术、助老机器人等场景中, 深度强化学习算法的进一步完善 MCTS与学习结合 :从AlphaGo、AlphaZero到MuZero, 以下内容将从强化学习与逆强化学习的最新学术与应用进展出发,imToken,降低对专家演示质量与数量的依赖,都在利用强化学习减少资源浪费并提高产能。

既能学习模型(环境动态)又能自适应地规划决策,强化学习系统具备更全面的信息处理能力。

https://blog.sciencenet.cn/blog-2089193-1469625.html 上一篇:深度学习、机器学习和强化学习三者的关系、最新进展及未来发展方向 下一篇:强化学习和模型预测控制(MPC)领域的最新进展及未来方向 ,不断涌现的新算法和新思路正推动着智能体在复杂任务中取得超越人类的表现,多智能体强化学习正在深化探索。

显著提升了复杂场景下的协同效率,而大规模预训练、模型可解释性、多模态融合等方向,增加对决策过程的可解释性、稳定性和安全性,研究者不断将蒙特卡罗树搜索(MCTS)与深度学习相结合, 代表性方法如Decision Transformer、Trajectory Transformer等,综合介绍其在全球范围内的研究热点与实践成果。

并应对分布差异与环境扰动。

结语